哎喲,我這暴脾氣!記得我第一次跑那個深度學習模型的時候,信心滿滿地敲下回車,結果等來的不是訓練進度條,而是一行冷冰冰的“RuntimeError: CUDA out of memory”-1。當時我就懵了,盯著我那顯卡發呆,心里頭那個憋屈啊,就像興沖沖地去吃大餐,結果發現錢包沒帶一樣。

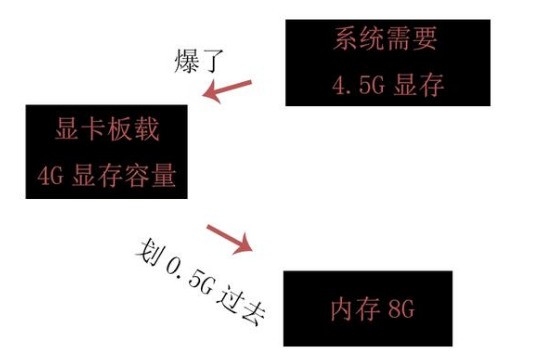

這顯存不夠會怎么樣?說白了,就是你顯卡的“工作臺”太小,而你要處理的“原材料”(模型參數、數據)太多,根本擺不下-1。最常見的,就是程序直接崩潰,訓練中斷,彈出一個類似“CUDA內存不足”的錯誤-3。這不僅僅是打斷你的工作那么簡單,有時候好幾個小時的訓練進度說沒就沒了,那感覺真是“豆腐掉進灰堆里——吹不得也拍不得”。

但這還不是最惱人的。有時候它不直接崩,而是開始“卡頓”,或者出現一些莫名其妙的渲染異常-3。我遇到過更絕的,是因為顯存碎片化問題-1。你可以把顯存想象成一個倉庫,本來有足夠的空地放一批大貨。但因為你之前頻繁地搬進搬出一些小零件,導致空地雖然總面積夠,卻被分割得七零八碎,沒有一塊完整的、連續的空間能放下新來的大家伙-3。這時候,系統明明顯示還有“空閑”顯存,可就是告訴你“內存不足”,那種感覺就像明明家里有地方,卻因為東西堆得太亂而找不到地方落腳,簡直讓人抓狂。

所以,當你開始琢磨“顯存不夠會怎么樣”的時候,其實你已經從單純抱怨硬件,轉向思考如何更聰明地利用資源了。這恰恰是解決問題的第一步。面對這個攔路虎,難道我們只能掏錢換更貴的顯卡嗎?當然不是!我后來發現,江湖上流傳著不少“四兩撥千斤”的妙招。

咱們得學會“精簡”。一個立竿見影的方法是啟用混合精度訓練。簡單說,就是把模型里大部分計算從FP32(單精度浮點數)轉換成FP16(半精度浮點數)。這一下子就能減少將近50%的顯存占用,而且對模型精度的影響通常很小-1。PyTorch等框架都有現成的工具(比如torch.cuda.amp)可以幫你自動完成,特別方便-4。

如果模型還是太大,可以試試梯度累積這個技巧。我們訓練模型時,一次處理的圖片或文本數量叫“批大小”(batch size)。批大小越大,對顯存需求就越高。梯度累積的思路是:我們先用一個較小的批大小跑幾次,把這幾次算出來的梯度都攢起來,等累積到一定程度,再用這些梯度的平均值去更新一次模型參數-1。這樣,我們就能用有限的顯存,“模擬”出使用更大批大小的效果-4。

對于層數非常深的模型,還有一個“用時間換空間”的終極武器:梯度檢查點。它在前向傳播時,只保存關鍵節點的輸出,而不是每一層的中間結果。等到反向傳播需要時,再臨時重新計算那些被丟棄的中間結果-4。這樣一來,能省下大量的顯存(尤其是存儲激活值的那部分),代價就是會增加一些計算時間,大約20%-30%-2-5。這就像你長途旅行,把所有行李都背上會很累(顯存不足),但你可以選擇只帶必需品,中途需要別的再買(重新計算),雖然可能多花點時間,但輕松多了。

除了自己手動優化,我們還可以站在巨人的肩膀上。現在有很多優秀的開源框架,就是專門為了在有限顯存下訓練大模型而生的。

比如Unsloth這樣的框架,它通過動態梯度壓縮、注意力機制優化等一系列“黑科技”,能大幅降低訓練時的顯存占用-2。有測試顯示,原本需要32GB以上顯存才能訓練的百億參數模型,使用Unsloth優化后,可能只需要7GB左右的顯存-2。這簡直就是給咱們這些用消費級顯卡的研究者和開發者開了扇窗。

另一個思路是模型量化。這是一種模型壓縮技術,通過降低模型權重和激活值的數值精度(比如從16位浮點數降到8位甚至4位整數)來減少存儲空間-5。一些激進的量化方法,配合參數共享等技術,甚至能嘗試將原本需要數十張專業顯卡才能運行的、擁有千億參數的混合專家模型,“塞進”單張24GB的消費級顯卡里運行-9。這聽上去有點天方夜譚,但確實是目前前沿探索的方向。

當然,如果你有多張顯卡(哪怕型號不完全一樣),分布式訓練是必由之路。通過像ZeRO(零冗余優化器)、張量并行、流水線并行這樣的技術,可以把模型參數、梯度、優化器狀態巧妙地拆分到不同顯卡上-5-6。例如,ZeRO-3階段能將參數、梯度和優化器狀態全部分區,幾乎線性地提升可訓練的模型規模-5。這就好比一個人干不完的重活,分給一個團隊來協作完成。

說到底,遇到顯存不足別急著灰心。它更像是一個提醒,逼著我們去更深入地理解模型、框架和硬件之間的協作。從調整batch_size開始,到嘗試混合精度、梯度累積,再到研究量化、并行,每一步都在提升我們的“煉丹”功力。這個過程本身,其樂無窮。

1. 網友“新手煉丹師”提問:我剛入門深度學習,顯卡只有6GB顯存,是不是什么都做不了?有沒有特別適合小顯存的入門練習項目?

朋友,千萬別這么想!6GB顯存在幾年前可是妥妥的中高端配置,能做很多事情。入門階段,關鍵在于選對項目和用好技巧。

避開“巨無霸”模型。不要一上來就去跑最新的千億參數大語言模型或超高分辨率圖像生成模型。可以從一些經典的、輕量級的模型和數據集入手,比如:

圖像分類:在CIFAR-10或CIFAR-100數據集上訓練ResNet-18、MobileNet這類小模型。把batch_size設小一點(比如32或16),完全可以在6GB顯存下流暢運行。

自然語言處理:嘗試在GLUE基準的某個任務(如情感分析SST-2)上微調一個BERT-base模型。使用bert-base-uncased這樣的版本,配合適當的batch_size和梯度累積,6GB顯存是足夠的-1。

教程項目:很多優秀的深度學習教程(比如PyTorch官方Tutorials)都會提供適配低顯存的代碼版本,是完美的起點。

立刻用上“顯存節省三件套”:

混合精度訓練(AMP):在PyTorch中,幾乎可以一鍵開啟。它能立刻讓你的可用“顯存空間”感覺大了一倍,是低顯存用戶的第一道護身符-1-4。

梯度累積:這是你“模擬”大batch_size體驗的神器。比如你想用batch_size=64的效果,但顯存只夠一次裝16張圖,那就設gradient_accumulation_steps=4,跑4次再更新參數,效果類似-1。

及時清理緩存:在PyTorch的訓練循環中,可以在每個epoch結束后或內存緊張時調用torch.cuda.empty_cache(),釋放掉不用的緩存-1。

養成監控習慣。在訓練時,打開終端,用nvidia-smi -l 1命令實時觀察顯存占用變化-3。這能幫你直觀地理解每個操作對顯存的影響。入門階段,在限制下解決問題獲得的經驗,遠比直接用頂級硬件“暴力破解”來得寶貴。堅持住,等你熟練掌握了這些技巧,未來給你大顯卡時,你才能把它用得更加出神入化。

2. 網友“創業團隊CTO”提問:我們初創公司資金有限,只有幾臺配置了RTX 4090(24GB顯存)的工作站。我們想在本地微調一些百億參數級別的行業大模型(比如DeepSeek),用于開發產品原型,有可能實現嗎?

完全有可能,而且這正是目前很多AI初創公司的標準打法。24GB的消費級旗艦卡,通過組合優化技術,完全有能力應對百億參數模型的微調(Fine-tuning),尤其是推理(Inference) 任務。關鍵在于采用“組合拳”策略,而不是硬扛。

核心策略是 “量化+參數高效微調+內存優化” :

模型量化加載:這是第一步,也是降顯存占用最猛的一步。不要加載完整的FP16模型。使用bitsandbytes等庫,直接以8位(INT8)甚至4位(NF4)精度將模型加載到顯存中-5。一個70億參數的模型,FP16需要約14GB,而INT8只需要約7GB,4位精度則更低。這能讓你先把“大象”請進房間。

參數高效微調(PEFT):微調時,不要動模型的所有參數。采用 LoRA(低秩適應) 或其變種QLoRA(量化LoRA) -5。QLoRA的意思是,加載一個4位量化的基礎模型,然后只訓練額外添加的、參數量極少的LoRA適配器層。這樣,需要更新的參數量可能只有原模型的0.1%-1%,顯存開銷極小,但效果卻能接近全量微調。

激活值優化:在微調訓練時,開啟梯度檢查點,以節省存儲中間激活值(Activation)的顯存-2-5。對于長文本序列任務,可以使用FlashAttention-2等優化的注意力層實現,它能更高效地利用顯存-5。

對于產品原型的推理,方案更靈活:

可以加載量化后(如8位)的模型直接進行推理,24GB顯存已經可以支持不少百億模型以不錯的批次進行推理。

使用vLLM或TGI這類高性能推理框架,它們自帶內存優化、動態批處理等功能,能極大提高顯存利用率和吞吐量-9。

如果單卡仍然不夠,可以考慮用兩臺工作站的顯卡做簡單的模型并行,將模型的不同層分布到不同的卡上。

你們的硬件配置完全在“戰斗范圍”內。建議的路線是:先從QLoRA微調一個量化模型開始,快速驗證想法和效果。隨著產品需求的明確和資金的充裕,再考慮租用云上更大顯存的實例進行全量微調或部署。這樣既能控制成本,又能快速迭代。

3. 網友“業余AIGC愛好者”提問:我喜歡玩Stable Diffusion畫圖,但我的顯卡只有8GB。生成高分辨率(比如1024x1024以上)或者用高精度模型時就經常爆顯存。除了換卡,有沒有在軟件和設置上的優化秘訣?

當然有!AIGC(AI生成內容)社區是“壓榨”顯卡潛力的高手,針對Stable Diffusion(SD)這類擴散模型,有很多成熟的優化方案。

第一,啟用終極省顯存模式:xFormers和注意力切片。

安裝xFormers庫:這是對于SD WebUI(或ComfyUI)用戶最重要的一步。xFormers庫提供了內存高效的自注意力層實現,能顯著減少生成高分辨率圖像時的顯存占用,并且通常還能加快生成速度。在WebUI的啟動命令中加入--xformers參數即可。

開啟注意力切片:如果即使用了xFormers,生成超大圖時還是OOM(顯存不足),可以嘗試啟用--opt-split-attention參數。它會將注意力計算過程進行拆分,進一步降低峰值顯存。

第二,玩轉模型精度與顯存管理。

使用FP16或BF16精度的模型:確保你下載的模型(如.safetensors文件)是FP16格式的,而不是FP32。FP32模型體積大,運行時顯存占用也高。

在WebUI設置中開啟“顯存優化”選項:比如“--medvram”或“--lowvram”模式。--medvram會讓SD在生成時更激進地釋放暫時不用的數據,適合6-8GB顯卡。--lowvram模式會更極端,將所有可能的數據在GPU和CPU之間交換,速度會慢,但能讓你在顯存很小的情況下“硬跑”起來。

及時清理:生成多批次圖片時,可以嘗試在每批次之間點擊WebUI上的“清理顯存”按鈕(或調用對應API),釋放累積的緩存。

第三,采用“先小后大”的高分辨率生成策略。

直接生成1024x1024以上的圖對顯存壓力巨大。可以采用高分辨率修復(Hires. fix) 或多步法:

先用一個較低的分辨率(比如512x512)生成你滿意的構圖和內容。

然后啟用“高分辨率修復”,選擇一個高倍率的放大算法(如R-ESRGAN 4x+),讓SD在較低顯存消耗下,將圖片放大到目標尺寸,并補充細節。這比直接生成大圖要節省得多。

第四,考慮使用優化后的推理框架。

如果你有一定技術能力,可以嘗試使用像TensorRT這樣的工具,為你的特定SD模型和顯卡生成高度優化的推理引擎。經過TensorRT優化后,不僅顯存占用會降低,生成速度也會有巨大提升。NVIDIA官方和社區都有相關的教程。

8GB顯卡玩SD絕對夠用,只是不能“無腦”開最高配置。通過軟件優化和合理的生成策略,你完全可以流暢地創作出高質量的作品。多逛逛相關社區,你會發現很多和你一樣用“神卡”創作出驚人作品的同好。